Alan Turing (1912-1954), un père fondateur de l’intelligence artificielle (IA) et l’inventeur du Test de Turing qui détermine si un ordinateur peut penser,1 a défini les algorithmes comme des ensembles d’instructions précises pour la résolution des problèmes.2 Aujourd’hui, les algorithmes décrivent de nombreuses méthodes de calcul.3 L’IA peut être définie comme des groupes d’algorithmes qui se modifient et créent de nouveau algorithmes en réponse aux nouvelles contributions dans le cadre d’un mécanisme décrit comme « intelligence ».4 Le fait que l’intelligence a été définie d’au moins 70 façons différentes complique les choses.5

Une autre définition propose que l’IA concerne les agents d’intelligence qui perçoivent leurs environnements et prennent des mesures pour maximiser leurs chances de succès.6 Les algorithmes d’IA sont donc différents des algorithmes classiques ; si l’environnement pose des problèmes que ses concepteurs n’ont jamais envisagés, les algorithmes d’IA doivent être adaptés - peut-être bien au- delà de leurs spécifications de conception originales - en es modifiant, complétant ou supprimant. La simple modification des coefficients dans un modèle statique ne constitue pas de l’IA.

Il convient d'explorer les considérations de la gouvernance d’entreprise des algorithmes d’IA.Le fait que les intérêts des actionnaires soient souverains dans certains modèles économiques semble aller à l’encontre des questions urgentes d’intérêt public avec des outils tels que l’IA.7 Il existe également des scénarios avec un risque d’atteinte à la réputation et de durabilité dans des organisations où les algorithmes d’IA ne fonctionnent pas comme prévu, ou voire pire, occasionnent des dommages. Les deux moteurs de ce risque sont le biais algorithmique et le manque de transparence,8 les biais pouvant être par exemple:9

Il convient d'explorer les considérations de la gouvernance d’entreprise des algorithmes d’IA.Le fait que les intérêts des actionnaires soient souverains dans certains modèles économiques semble aller à l’encontre des questions urgentes d’intérêt public avec des outils tels que l’IA.7 Il existe également des scénarios avec un risque d’atteinte à la réputation et de durabilité dans des organisations où les algorithmes d’IA ne fonctionnent pas comme prévu, ou voire pire, occasionnent des dommages. Les deux moteurs de ce risque sont le biais algorithmique et le manque de transparence,8 les biais pouvant être par exemple:9

- Système de reconnaissance vocale de Google— conçu et testé sur les hommes—qui a du mal à reconnaître les voix féminines.

- Amazon a abandonné son programme de recrutement en IA après qu’il ait été découvert qu’ils n’ont pas considéré les profils féminins.

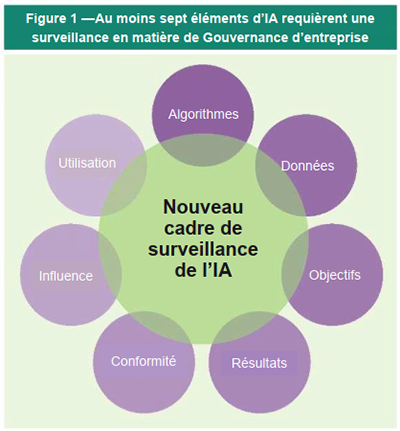

En termes de gouvernance et de responsabilité, les algorithmes constituent seulement un des au moins sept éléments d’IA requérant une certaine surveillance, les autres étant par exemple les données, les objectifs, les résultats, la conformité, l’influence et l’utilisation (figure 1).10

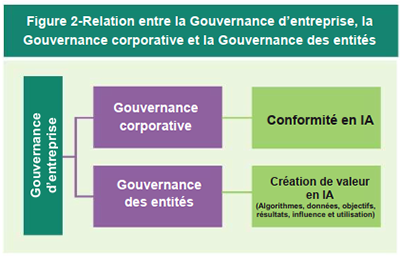

Comme le montre la figure 2, tandis que l’aspect conformité de la gouvernance d’entreprise - gouvernance corporative - traite de la conformité (par ex., par l’intermédiaire du comité d’audit du conseil) et de la gouvernance des entités, l’aspect performance de la gouvernance d’entreprise relève de la responsabilité du conseil dans son ensemble et doit couvrir les autres éléments créateurs de valeur représentés à la figure 1. Figure 2 Il est utile de noter que l’expression « gouvernance des entités » est utilisée pour généraliser l’expression plus communément utilisée « gouvernance d’entreprise » pour s’adapter aux organisations ou agences à but non lucratif ou du secteur public.

Figure 2 Il est utile de noter que l’expression « gouvernance des entités » est utilisée pour généraliser l’expression plus communément utilisée « gouvernance d’entreprise » pour s’adapter aux organisations ou agences à but non lucratif ou du secteur public.

La figure 2 illustre comment, du point de vue de la gouvernance d’entreprise, les développements de l’IA peuvent très mal tourner. Si le seul contrôle au niveau du conseil pour l’IA est la gouvernance corporative, alors en l’absence des réglementations pertinentes dans une juridiction particulière, pratiquement rien ne fonctionne. Toutefois, du point de vue de la gouvernance des entités, le conseil peut poser à la direction une question d’éthique et sociale importante, questions concernant la nature de la technologie - mais uniquement si le conseil dispose des connaissances nécessaires pour poser ces questions. Malheureusement, on ne peut faire une telle supposition vu la faible culture du numérique de nombreux conseils d’administration (BoDs).11

Diversité et portée des défis en matière d’IA

Un conseil ayant une culture numérique connaîtra les éléments suivants d’IA et les algorithmes d’IA dans le cadre de ses responsabilités fiduciaires pour la gouvernance d’entreprise :

- IA de mauvaise qualité–Plus les données utilisées pour tester et former un système d’IA sont compromises, plus les résultats des algorithmes d’IA sont compromis. Par exemple, des données notoirement mauvaises ont entraîné la suspension de Medicaid pour 4 000 personnes handicapées par un système d’IA dans l’État américain de l’Idaho, aboutissant à de grandes difficultés financières .12

- La boîte noire–Les algorithmes d’IA sont si complexes que, dans certains cas, il est impossible de savoir pourquoi on a abouti à un résultat particulier, tirant la sonnette d’alarme du point de vue légal pour des cas allant des diagnostics médicaux aux véhicules autonomes. Par exemple, une panne d’un système de pilote automatique d’IA de Tesla a entraîné un décès, et un véhicule autonome Uber a tué un piéton durant les essais.13

- Préoccupation d’intérêt public–Il est possible que l’IA soit développée selon les intérêts privés propres à ses fabricants, lesquels peuvent ne pas être dans le meilleur intérêt du public. Par exemple, les algorithmes d’IA de Mercedes ont été programmés pour sauver le conducteur et les passagers en cas d’accident, en opposition aux personnes se trouvant hors du véhicule, incitant à et si l’alternative était de conduire sur le trottoir et de tuer 20 piétons ? De même, les algorithmes d’IA de Facebook ont « délibérément » été utilisés pour façonner la perception du public des affaires en cours.14

- S’en remettre à l’IA–On considère en général que l’IA est supérieure à l’intelligence humaine. Par exemple, les pilotes déjà habitués aux systèmes de pilote automatique des avions peuvent avoir été mis à mal par les algorithmes d’IA 737 Max de Boeing, ceux-ci se retrouvant soudain à piloter des avions en des circonstances difficiles dues à des décisions erronées prises par les systèmes de bord.15

- IA à faible coût-–Un moteur de l’IA est plus économique que l’équivalent humain, même si l’IA est parfois bien moins précise que les humains. Par exemple, les algorithmes de reconnaissance faciale utilisés par la police métropolitaine au Royaume-Uni ont donné lieu à des faux positifs d’identification criminelle dans plus de 90 pour cent des cas.16

Il convient également de considérer des effets indésirables de l’IA sur la société, tels que des erreurs pouvant ne pas encore être visibles dans des cas d’utilisation émergente, la perte de l’esprit critique et un manque de compréhension, le risque de manipulation néfaste des algorithmes, la perte de la touche humaine et du rôle du jugement humain dans la prise de décisions importantes.17 Ceci n’inclut pas les problèmes de confidentialité et d’audit inhérents à l’IA. Tous sont des problèmes de gouvernance d’entreprise.

Les questions éthiques avec le développement de l’IA, telles que la concentration des ressources dans un faible nombre d’organisations puissantes telles que Amazon, Facebook, Microsoft, Google, Apple, IBM et Tesla, où la gouvernance est « anormalement autocratique et manque de responsabilité » sont une préoccupation majeure.18 Ce contrôle qui revient à un petit groupe d’initiés qui ont de fortes interactions et des intérêts similaires compromet l’objectivité et invite à se demander si les besoins d’un petit groupe compromettent l’intérêt public du plus grand nombre.19

Alors que la réglementation peut réduire le risque pour le public posé par l’IA, les gouvernements prétendent que ceci peut freiner l’innovation et réduire l’avantage concurrentiel. Il est également difficile d’établir des réglementations avant qu’une nouvelle variante de l’IA ne soit déployée, et il est complexe de mettre en place des réglementations spécifiques de l’IA après les faits, vu l’introduction potentielle d’une lacune en matière de responsabilité.20 This is a challenge for the role of corporate governance in AI oversight (figure 2), Il s’agit d’un défi à relever par la gouvernance corporative en matière de surveillance de l’IA (figure 2), qui dans certaines organisations peut être le seul niveau de surveillance de l’IA exécuté.

IL EST ESSENTIEL QUE LES MEMBRES DU CONSEIL D’ADMINISTRATION CONNAISSENT LE MODE DE CRÉATION, D’UTILISATION OU DE VENTE DE L’IA PAR LEUR ORGANISATION.Appel à l’action du Conseil

Il est essentiel que les membres du conseil d’administration connaissent le mode de création, d’utilisation ou de vente de l’IA par leur organisation. Ils peuvent y parvenir grâce à la conformité, la planification stratégique ou la supervision traditionnelle du risque juridique ou commercial. Un conseil d’administration a la responsabilité fiduciaire de garantir proactivement le déploiement éthique de l’IA.

Tout comme concernant toute recherche de connaissances, on part à zéro. Un élément d’exploration de l’IA par le conseil et la direction doit être mis à l’ordre du jour des réunions, et il convient d’y consacrer du temps afin de s’assurer que les personnes appropriées se trouvent dans la pièce pour répondre à des questions telles que :

- Qu’est-ce que l’IA ?

- Cette définition et la portée peuvent être différentes d’une organisation à une autre. Les parties prenantes ne doivent jamais démarrer avec une hypothèse.

- Qui dirige et régit l’IA ?

- Comment l’IA changera/aura une incidence sur les affaires de l’organisation ? L’équipe de direction a-t-elle une conception partagée ?

- Quelle est la stratégie en matière d’IA ?

- Quel sera le bénéfice d’une stratégie forte en matière d’IA dans 3-5 ans ? L’organisation dispose-t-elle des processus et personnes nécessaires pour exécuter cette stratégie ?

- En quoi l’IA marquera une différence ?

- Quel pourrait-être l’avantage stratégique ?

Ces questions donneront lieu à des conversations pertinentes et permettront au conseil dans son ensemble de mieux comprendre le paysage de l’IA et l’approche de l’IA adoptée par l’organisation.

ALORS QUE LES AVANTAGES DE L’IA SONT DE PLUS EN PLUS CLAIRS, RIEN N’INDIQUE CLAIREMENT UNE COMPRÉHENSION GÉNÉRALE DU PROFIL DE RISQUE TECHNOLOGIQUE.Cette conversation se dirigera naturellement vers le sujet du risque et de la gouvernance. Même si l’IA est de plus en plus adoptée, la surveillance et l’atténuation de ses risques demeurent une tâche urgente et non résolue. Même si 41 pour cent des personnes interrogées lors d’un sondage international sur l’IA ont déclaré que leurs organisations « identifient et hiérarchisent globalement » les risques associés au déploiement de l’IA, beaucoup moins atténuent ces risques.21

La surveillance des risques est de plus en plus compliquée et, par conséquent, les administrateurs doivent savoir quelles questions poser. Rappelons que commencer avec les bases aidera à acquérir de solides connaissances de base:

- Qui supervise l’utilisation de l’IA et des risques associés ? Est-ce la même équipe qui dirige l’initiative ?

- Dans quelle mesure l’organisation utilise des contrôles effectués par l’homme?

- Qui a développé les politiques d’audit pour les modèles d’IA ?

- L’organisation est-elle vulnérable aux attaques ? Quels plans en matière de risques sont en place pour traiter cette menace ?

Sachez qu’au niveau national au Canada, 50 pour cent des personnes interrogées lors d’un sondage de directeurs d’entreprise sur des questions importantes d’ordre politique, social et économique touchant les organisations et le pays ont identifié l’IA et l’automatisation comme des problèmes majeurs pour le pays (et, par conséquent, pour la politique), mais seulement 28 pour cent considéraient qu’il s’agissait d’un problème majeur pour leur organisation.22 Pour ceux qui relèvent le défi, le potentiel de l’IA à apporter des avantages significatifs dans les secteurs privé et public pose un risque nouveau et complexe. Une meilleure maîtrise et visibilité par le conseil de l’IA est une bonne gouvernance. Un conseil, ses comités et administrateurs individuels peuvent aborder ces sujets comme une question de stricte conformité, planification stratégique, ou de surveillance traditionnelle du risque juridique et commercial.

Il est également difficile pour les Conseils d’administration de comprendre les aspects de confidentialité et d’éthique de l’IA. En cas de problème, qui serait tenu responsable pour tout résultat inattendu de l’IA ? Qui serait tenu responsable pour le problème et qui serait responsable d’y remédier ? Les systèmes et algorithmes d’IA peuvent-ils être inspectés et les décisions qui en résultent peuvent-elles être totalement expliquées ?

Les conseils d’administration peuvent s’assurer que l’IA soit sur leur programme interne et que le recrutement des nouveaux administrateurs tienne explicitement compte de ces lacunes en matière de compétences. Les pratiques de gouvernance doivent évoluer concernant l’IA, y compris en identifiant la formation requise pour que les administrateurs soient informés du paysage de l’IA qui évolue rapidement.

Enfin, la surveillance par le conseil doit inclure les exigences de l’organisation dans les politiques de l’entreprise précisant les différents systèmes d’IA qui seront utilisés et confirmant que la direction - et pas seulement l’informatique - est suffisamment recentrée et dûment équipée pour gérer la conformité et les risques en matière d’IA.

Appel à l’action de la Direction

Alors que les avantages de l’IA sont de plus en plus clairs, rien n’indique clairement une compréhension générale du profil de risque technologique. Un administrateur averti devrait pouvoir facilement comprendre pourquoi l’IA doit être au programme des comités des risques, d’éthique et d’audit - pas seulement le comité informatique - le programme incluant des éléments tels que l’équité, l’exactitude et la sécurité, et la gouvernance et les pratiques de responsabilisation incluant le leadership, engagement, structures organisationnelles et formation.23 Les éventuelles réponses de la direction à ces impératifs de surveillance peuvent être notamment :

- Le fait de s’assurer que des programmes de qualité des données sont en place et que les données utilisées représentent ce qui devrait être plutôt que la réalité afin de limiter les données biaisées24—et incomplètes, indépendamment de leur caractère irréprochable, sera non représentatif et, par conséquent, instaurera un parti pris

- Les composants de diagnostique établis dans les algorithmes d’IA avant le déploiement25

- Les groupes vastes et diversifiés de parties prenantes qui évaluent l’efficacité des algorithmes d’IA proposés

- Établissement de vérifications et contrepoids réguliers pour la prise de décisions avec l’IA par rapport aux décisions humaines

- Établissement de la validation humaine pour la prise de décisions critiques sur la base de l’IA. La plupart des diminutions des coûts grâce à l’IA ont été dans la chaîne d’approvisionnement, la fabrication et les opérations de services à ce jour,26 il sera important d’identifier les domaines où une prise de décision sur la base d’un faux positif entraîne un plus grand risque d’effets négatifs significatifs.

Une partie importante du programme de la direction consiste à s’assurer que le président-directeur général (PDG) soit dûment informé des activités, conclusions et préoccupations de la direction concernant les déploiements de l’IA.

Conclusion

Les hauts dirigeants du secteur commencent à réprimander les grandes entreprises basées sur les algorithmes qui trompent « les utilisateurs sur l’exploitation des données, [et] sur les choix n’étant pas du tout des choix », dont certains tentent de découvrir dans quelle mesure ils peuvent y échapper plutôt que de considérer les conséquences sociétales de leurs activités.27 Alors qu’il semble y avoir une certaine réticence à réglementer l’IA dans certaines juridictions, « [l]es problèmes d’IA à haute visibilité affecteront la confiance des clients et serviront uniquement à augmenter les contraintes réglementaires futures. Ce qui est facilement évité de nos jours grâce à des mesures proactives. ».28

Dans le cadre de cette proactivité, des appels à action ont été faits dans les présentes pour le conseil et pour la direction, cette dernière étant dirigée par le PDG, fonction à laquelle le conseil délègue des pouvoirs et qui est nommée pour créer de la valeur (gouvernance des entités à la figure 2) dans les limites des paramètres fixés par le conseil. Ces paramètres du conseil sont notamment les vérifications et contrepoids nécessaires pour s’assurer du déploiement responsable de l’IA dans l’organisation, ou au sein des produits créés et vendus.

BEAUCOUP SONT UNANIMEMENT EN FAVEUR D’UNE BONNE IA, ET PAR EXTENSION, D’UNE FORTE GOUVERNANCE D’ENTREPRISE (PLUTÔT QUE LA GOUVERNANCE CORPORATIVE UNIQUEMENT) DES ALGORITHMES D’IA.Par conséquent, quel est le coût d’une absence de gouvernance d’entreprise des algorithmes d’IA ? Il est accepté que l’IA date seulement de 65 ans et en est encore à ses débuts, mais des scandales déstabilisants tels que ceux des rôles de Cambridge Analytica et Facebook influençant le résultat de l’élection présidentielle américaine de 2016 donnent une idée du pouvoir de la technologie de déchirer le tissu social unifiant la société - tout comme elle a la possibilité de le réparer et renforce.29

Beaucoup sont unanimement en faveur d’une bonne IA, et par extension, d’une forte gouvernance d’entreprise (plutôt que la gouvernance corporative uniquement) des algorithmes d’IA. On espère que les personnes responsables de son élaboration - Conseils d’administration d’organisations engagées dans la mise en oeuvre de l’IA - partagent cette inspiration et qu’elles développeront considérablement leurs compétences dans ce domaine important avant d’exécuter des scénarios des risques organisationnels ou sociétaux potentiellement dommageables.

Bibliographie

1 Copeland, B. J.; “Alan Turing,” Britannica,

https://www.britannica.com/biography/Alan-Turing

2 Petzold, C.; The Annotated Turing, Wiley,

États-Unis, 2008

3 McFadden, C.; “The Origin of Algorithms We

Use Every Single Day,” Interesting Engineering, 5 septembre 2020, https://interestingengineering.com/origin-algorithms-use-every-day

4 Ismail, K.; “AI vs Algorithms: What’s the

Difference,” CMS Wire, 6 octobre 2018,

https://www.cmswire.com/information-management/ai-vs-algorithms-whats-the-difference/

5 Larsson, S.; F. Heintz; “Transparency in Artificial Intelligence,” Internet Policy Review, vol. 9, iss. 2, 5 May 2020, https://policyreview.info/concepts/transparency-artificial-intelligence

6 Kallem, S. R.; “Artificial Intelligence Algorithms,”

IOSR Journal of Computer Engineering,

vol. 6, iss. 3,septembre/octobre 2012

7 Dignam, A.; “Artificial intelligence, Tech

Corporate Governance and the Public Interest

Regulatory Response,” Cambridge Journal of

Regions, Economy and Society, vol. 13, is. 1er

mars 2020, https://academic.oup.com/cjres/article/13/1/37/5813462?login=true

8 Butcher, J.; I. Beridze; “What Is the State of

Artificial Intelligence Governance Globally?”

The RUSI Journal, vol. 164, 2019, p. 5–6,

https://www.tandfonline.com/doi/pdf/10.1080/03071847.2019.1694260?needAccess=true

9 Op cit Dignam

10 Op cit Larsson et Heintz

11 Pearce, G.; “Digital Transformation: Boards Are

Not Ready for It,” ISACA® Journal, vol. 5, 2018,

https://www.isaca.org/archives

12 Op cit Dignam

13 Ibid.

14 Ibid.

15 Ibid.

16 Ibid.

17 Brahm, C.; “Tackling AI’s Unintended

Consequences,” Bain & Company, 3 avril 2018,

https://www.bain.com/insights/tackling-ais-unintended-consequences/

18 Op cit Dignam

19 Ibid.

20 Op cit Butcher et Beridze

21 Cam, A.; M. Chui; B. Hall; “Global AI Survey: AI Proves Its Worth, but Few Scale Impact,”

McKinsey & Company, 22 novembre 2019,

https://www.mckinsey.com/featured-insights/artificial-intelligence/global-ai-survey-ai-proves-its-worth-but-few-scale-impact

22 Institute of Corporate Directors, Directorlens

Survey Spring 2019, Canada, 2019

23 Hosanagar, K; “Why Audits Are the Way

Forward for AI Governance,” Wharton School, Université de Pennsylvanie, Pittsburgh, États-Unis,,

4 novembre 2019, https://knowledge.wharton.upenn.edu/article/audits-way-forward-ai-governance/

24 Shin, T.; “Real-Life Examples of Discriminating

Artificial Intelligence,” Towards Data Science,

4 juin 2020, https://towardsdatascience.com/real-life-examples-of-discriminating-artificial-intelligence-cae395a90070

25 Op cit Dignam

26 Statista, “Cost Decreases From Adopting

Artificial Intelligence (AI) in Organizations

Worldwide as of Fiscal Year 2019, by Function,”

novembre 2020, https://www.statista.com/statistics/1083516/worldwide-ai-cost-decrease/

27 Bariso, J.; “Tim Cook May Have Just Ended

Facebook,” Inc., 30 Jan 2021,

https://www.inc.com/justin-bariso/tim-cook-may-have-just-ended-facebook.html

28 Op cit Hosanagar

29 Sabbagh, D.; “Trump 2016 Campaign ‘Targeted

3.5M Black Americans to Deter Them From

Voting,” The Guardian, 28 septembre 2020, https://www.theguardian.com/us-news/2020/sep/28/trump-2016-campaign-targeted-35m-black-americans-to-deter-them-from-voting

Guy Pearce, CGEIT, CDPSE

A siégé à des conseils de gouvernance dans le secteur bancaire, les services financiers et dans une organisation à but non lucratif, et a occupé le poste de directeur général (PDG) d'une société internationale de services financiers. Son intérêt pour l’intelligence artificielle (IA) vient du traitement automatique de textes (NLP) dans Prolog à la fin des années 1980 et a été ravivé par l’émergence des technologies d’IA. Consultant en transformation numérique, données et gouvernance, Pearce partage volontiers son expérience d’auteur et de conférencier et a reçu le prix du Meilleur Auteur Michael Cangemi 2019 ISACA® pour ses contributions à la gouvernance des technologies de l'information. Il occupe le poste de responsable numérique et des données chez Convergence.Tech, une société canadienne de transformation numérique exerçant ses activités dans le monde entier.

Maureen Kotopski

Est une administratrice nationale qui a occupé le poste de présidente de la gouvernance et des politiques et a siégé dans des comités en ressources humaines. Avec des certifications du conseil du Rotman Institute of Corporate Directors (ICD) (Toronto, Ontario, Canada), elle est un leader incontesté en développement de la gouvernance et des politiques des conseils d’administration. Kotopski travaille actuellement dans un cabinet de conseils technologiques spécialisé en données massives et technologie des crimes financiers. Elle a précédemment dirigé des initiatives technologiques complexes couvrant les mises en oeuvre des systèmes, la conformité, la stratégie et la conception organisationnelle. L’expérience de Kotopski en technologie des entreprises et exploitation des données au bénéfice de l’entreprise a bénéficié à sa carrière et à ses contributions aux conseils d’administration.